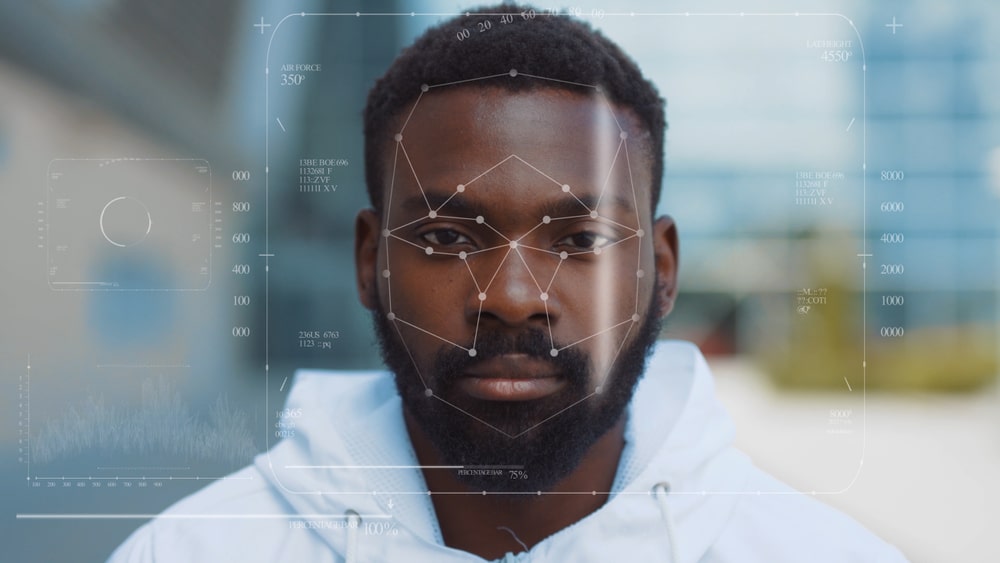

Die Gesichtserkennungssoftware war bereits bei ihrer Einführung stark umstritten. Die Angst mancher Expert*innen bestand darin, dass sie durch „rassistische“ Datensätze zu Fehleranfälligkeit bei Minderheitenangehörigen tendieren könnte. Wie sich jetzt nach und nach zeigt, scheinen die Sorgen leider berechtigt gewesen zu sein.

Kalkulierte Fehlerhaftigkeit

Eine Fehleranfälligkeit, die niemanden wirklich überrascht, denn Forschungsergebnisse aus der Vergangenheit hatten die Befürchtungen schon längst untermauert. Die Behörden beschwichtigten und hielten am Einsatz der technischen Gesichtserkennungssoftware fest. Der Öffentlichkeit wurde dabei hoch und heilig versprochen, dass die letzte Instanz immer noch ein Mensch sei, welcher das Ergebnis der Software kontrolliert. Dass das aber so nicht ganz der Wahrheit entspricht, zeigt nun ein weiterer beschämender Fall aus Louisiana, USA.

Denn dort musste ein unschuldiger Mann eine Woche ins Gefängnis: aufgrund einer fehlerhaften Identifizierung durch eine Gesichtserkennungssoftware. Polizisten stützten sich dabei auf eine fehlerhafte Übereinstimmung und überprüften bei dem vermeintlichen Verdächtigen weder Größe noch Gewicht. Sie sahen sich den Ausweis des Mannes nicht näher an, bevor sie ihn für eine Woche hinter schwedische Gardinen verschwinden ließen. Der 28-jährige Randal Reid wurde aufgrund dieses Fehlers unschuldig seiner Freiheit beraubt. Dabei war der Mann in seinem Leben zuvor noch nie in Louisiana gewesen. Doch wie konnte es erst so weit kommen? Und warum zur Hölle sperrt die Polizei Menschen ein, ohne Überprüfung einfachster Daten?

Gesichtserkennungssoftware fehleranfällig

Die Befürchtungen waren so alt wie die Gesichtserkennungssoftware selbst. Es erschien einfach zu logisch und naheliegend. Gesichtserkennungssoftwares wurden schließlich mit Datensätzen resultierend aus Racial Profiling gefüttert. Um 2019 herum nahm dann die Debatte an Fahrt auf. Hauptverantwortlich dafür waren Menschenrechtsorganisationen, welche auf den immer häufigeren Einsatz hinwiesen. Eine Untersuchung des National Institute of Standards und Technology bestätigte dann die Annahmen der Kritiker*innen. Das Programm erkennt Menschen mit nicht weißer Hautfarbe weitaus schlechter als Menschen mit weißer Hautfarbe. Und das mit einer Fehlerquote, die weit über dem Toleranzbereich liegt.

So wurden Menschen mit asiatischen und afroamerikanischen Aussehen hundertmal öfters falsch identifiziert. Die Ergebnisse zeigten außerdem, dass speziell afroamerikanische Frauen noch mal schlechter erkannt werden. Zudem scheint die Gesichtserkennungssoftware ebenfalls bei Kindern und älteren Personen besonders fehleranfällig zu sein.

Ein an sich ernüchterndes Urteil, dass die Softwareentwickler noch mal an das Zeichenbrett hätte führen müssen. Wie wir nun wissen, ist das aber nicht passiert. Was für die Gesellschaft nicht gut genug war und eine potenzielle Gefahr darstellte, schien für die Polizei aber ausreichend zu sein. Gerade in den USA hat sich der Einsatz der Gesichtserkennungssoftware seitdem rapide gesteigert.

Wie merkt man überhaupt, dass die Gesichtserkennungssoftware Fehler macht?

Das National Institute of Standards hat sich in einer Forschungsarbeit verschiedene Systeme der Gesichtserkennungssoftware näher angeschaut. Die Fehleranfälligkeit war bei allen ähnlich. Für den Aufbau der Studie hat man sich ähnliche Suchanfragen zurechtgelegt, wie sie die Behörden praktizieren. Dabei vergleichen in erster Linie Beamte das Bild einer verdächtigen Person mit einer Datenbank.

Laut der Studie konnte dabei mit „empirische Evidenz“ nachgewiesen werden, dass die meisten Gesichtserkennungsalgorithmen sogenannte „demografische Unterscheidungen“ darstellen. Dies führt schlussendlich zu einer niedrigen Genauigkeit im Hinblick auf Ethnie, Alter und Geschlecht.

Das Problem mit der Fehleranfälligkeit ist dabei keine Kleinigkeit. Denn die Gesichtserkennungssoftware kommt öfters zum Einsatz, als man denkt. Die Statistiken zeigen, dass das FBI in den letzten 12 Jahren über 390.000 Suchanfragen mittels der Methode durchführte. In Österreich hat die Polizei im Zuge einer parlamentarischen Anfrage der SPÖ-Nationalratsabgeordneten Katharina Kucharowits im Jahr 2021 angegeben, die Gesichtserkennungssoftware seit ihrer Einführung Ende 2019 insgesamt 1.574 Mal eingesetzt zu haben.

Die Studienautoren des National Institute of Standards sprechen davon, „schockiert“ zu sein und fordern unbedingt genauere Richtlinien und staatliche Kontrollen beim Einsatz der Gesichtserkennungssoftware. Aufgrund der Ergebnisse und der Fehleranfälligkeit wurde die Software in San Francisco und Oakland verboten. Später zogen noch weitere US-Bundesstaaten bei dem Verbot nach. Doch leider nicht in Louisiana, wie der 28-jährige Randal Reid nun am eigenen Leib erfahren musste.

Nicht mal Größe und Gewicht überprüft

Randal Reid war am 25. November unterwegs zu seiner Mutter, um an einer nachträglichen Thanksgivingsfeier teilzunehmen. Als Ried auf der Interstate twenty in Kalb County, Georgia das Blaulicht der Polizei im Rückspiegel sah, ging er zunächst von einer Geschwindigkeitsübertretung aus. Nichts ahnend, fuhr der 28-Jährige an die Seite und leistete den Anweisungen der Beamt*innen Folge. Auf das, was folgte, kann man wohl nicht vorbereitet sein. Die Beamten meinten zu Reid, dass es einen angeblichen Haftbefehl gegen ihn gebe aus einem Ort namens Jefferson Parish in Louisiana.

Dieser basierte auf einem fehlerhaften Treffer einer Gesichtserkennungssoftware. Er wurde beschuldig, Teil eines Trios zu sein, dass zuvor Markentaschen geklaut hatte. Der Haken an der Sache war nur folgender, Reid war zuvor noch nie im Leben in Louisiana gewesen. Die Beamten nahmen den unschuldigen Mann in Gewahrsam und überstellten ihn daraufhin in das Gefängnis von Carp County.

Sein Martyrium hielt knapp eine Woche an. Am 1.Dezember wurde Reid stillschweigend entlassen. Tommy Calogero der Anwalt von Randal Reid, ist sich sicher, dass die Beamten hier ihren eigenen Fehler bemerkt haben. Aber was, wenn nicht? Wie lange hätte sein Mandant wohl noch völlig unschuldig im Gefängnis schmoren müssen?

Muttermal und 18 kg Gewichtsunterschied

Der Betroffene beschreibt seine Zeit im Gefängnis als den puren Horror. Er konnte weder schlafen noch essen und dachte permanent über die Anklage nach. Wohl wissend, dass es sich um einen Fehler handelt. Die Beamten hatten sich nicht mal die Mühe gemacht, seinen Personalausweis richtig zu überprüfen.

Zudem hat Reid ein auffälliges Muttermal, welches ihn vom gesuchten Verdächtigen unterscheidet. Dieses Muttermal und ein Gewichtsunterschied von 18 kg zwang letztendlich die Polizei, ihn freizulassen. Unterdessen möchten die Behörden keine Auskunft darüber geben, welche Gesichtserkennungssoftware hier konkret im Einsatz war. Durch den Fall sehen sich Kritiker*innen weiter bestätigt. Es zeigt sich, dass Gesichtserkennungssysteme im Hinblick auf Voreingenommenheit und Datenschutz noch einiges an Nachholbedarf haben.

Electronic Frontier Foundation, eine amerikanische Non-Profit-Organisation zu Verteidigung der Privatsphäre und Meinungsfreiheit, fordert schon seit Längerem ein landesweites Verbot der Gesichtserkennungssoftware. Der Trend scheint aber gerade eher in die andere Richtung zu gehen.

Gesichtserkennungssoftware in Österreich

Seit 2019 kommt die Gesichtserkennungssoftware beim Bundeskriminalamt zum Einsatz. Eine Einbindung der Landeskriminalämter wurde damals bereits angekündigt. Die Software kommt dabei von unseren deutschen Nachbarn. Und zwar dem Dresdner Unternehmen Cognitec Systems.

Ablauf der Tätersuche funktioniert dabei aber genauso wie in Amerika. Das Programm ermöglicht es der österreichischen Polizei, Bilder von Überwachungskameras mit ihrer eigenen Referenzdatenbank automatisiert abzugleichen. Sobald die Gesichtserkennungssoftware einen Treffer vermeldet, haben die Beamten eine*n Täter*in. Sofern das Programm richtig gearbeitet hat. Derzeit ist bei uns in Österreich nach wie vor kein Abgleich in Echtzeit geplant.

Titelbild © Shutterstock

DAS KÖNNTE SIE AUCH INTERESSIEREN

Warum du auf die Oasis Reunion-Konzerte pfeifen solltest!

Auf die Oasis-Reunion folgten auch schon gleich die Konzerttermine. Doch es gibt gute Gründe, auf die Oasis Reunion-Konzerte zu pfeifen.

China und die Wahrheit: Zhang Zhans Kampf um Pressefreiheit

Weltweit nehmen die Entwicklungen in Bezug auf Medien und Presse wie auch das Vertrauen der Bevölkerung in sie einen dramatischen […]

LGBTQIA*: 10 Sätze, die queere Personen nicht mehr hören können

Von ehrlicher Neugier bis hin zu völligen Respektlosigkeiten – obwohl die LGBTQIA*-Bewegung in den letzten Jahren immer mehr Fortschritte hinsichtlich […]

Oatly Hafermilch: der Börsengang gegen die eigenen Prinzipien?

Mit seinem signature Haferdrink hat sich das kleine schwedische Unternehmen Oatly im Laufe der vergangenen Jahre zum konkurrenzfähigen Weltmarkt-Riesen gemausert. […]

Die absurdesten Verschwörungstheorien

Sie verweben Unglaubliches, Fantastisches und Wahnhaftes. Wir haben die absurdesten Verschwörungstheorien für dich gefunden.

Victim blaming: Können Frauen Vergewaltigungen verhindern?

Basel, Februar 2020: Eine 33-Jährige wird am Heimweg von zwei Männern vergewaltigt. Einer der Täter legte Berufung ein und erreichte […]